Apple будет использовать Google Gemini (1.2 триллиона параметров) для переосмысления Siri с выпуском iOS 26.4 весной 2026 года

Это сигнал: даже технологические гиганты приоритизируют пользовательский опыт над корпоративной гордостью, когда речь идёт об AI

Для бизнеса это означает: партнёрства между конкурентами становятся нормой в эпоху языковых моделей — никто не может быть лидером во всём одновременно

Контекст: от провалов Siri к стратегическому альянсу

Siri была когда-то революционным голосовым ассистентом, запущенным на iPhone 4S в 2011 году. Но за последние пять лет она стала символом неудачи Apple в области искусственного интеллекта. Пока Google Assistant, Alexa и ChatGPT продвигались вперёд, Siri застревала на элементарных запросах вроде "какая погода?" и простых команд управления устройством. Apple обещала улучшения год за годом, но ничего существенно не менялось.

В июне 2024 года на конференции WWDC 2024 Apple анонсировала "Apple Intelligence" — амбициозный план переосмыслить AI в своих устройствах. Это была первая крупная AI-инициатива компании. Однако когда в октябре 2024 года вышли iOS 18 и iPhone 16 с первыми функциями Apple Intelligence (в iOS 18.1 28 октября), стало ясно: Apple не готова конкурировать на поле языковых моделей собственными силами. Интеграция ChatGPT была запущена лишь в iOS 18.2 (декабрь 2024), а функционал новой Siri остался урезанным.

Это не просто сотрудничество двух компаний. Это символ того, что эра монопольного контроля над AI завершается. Даже Apple — компания, построившая империю на замкнутых экосистемах — вынуждена открывать двери конкурентам, чтобы доставить то, что хотят пользователи. При этом выбран именно Google, а не бывший партнёр OpenAI, что показывает новую расстановку сил в AI-индустрии.

Что меняется в архитектуре Siri (iOS 26.4)

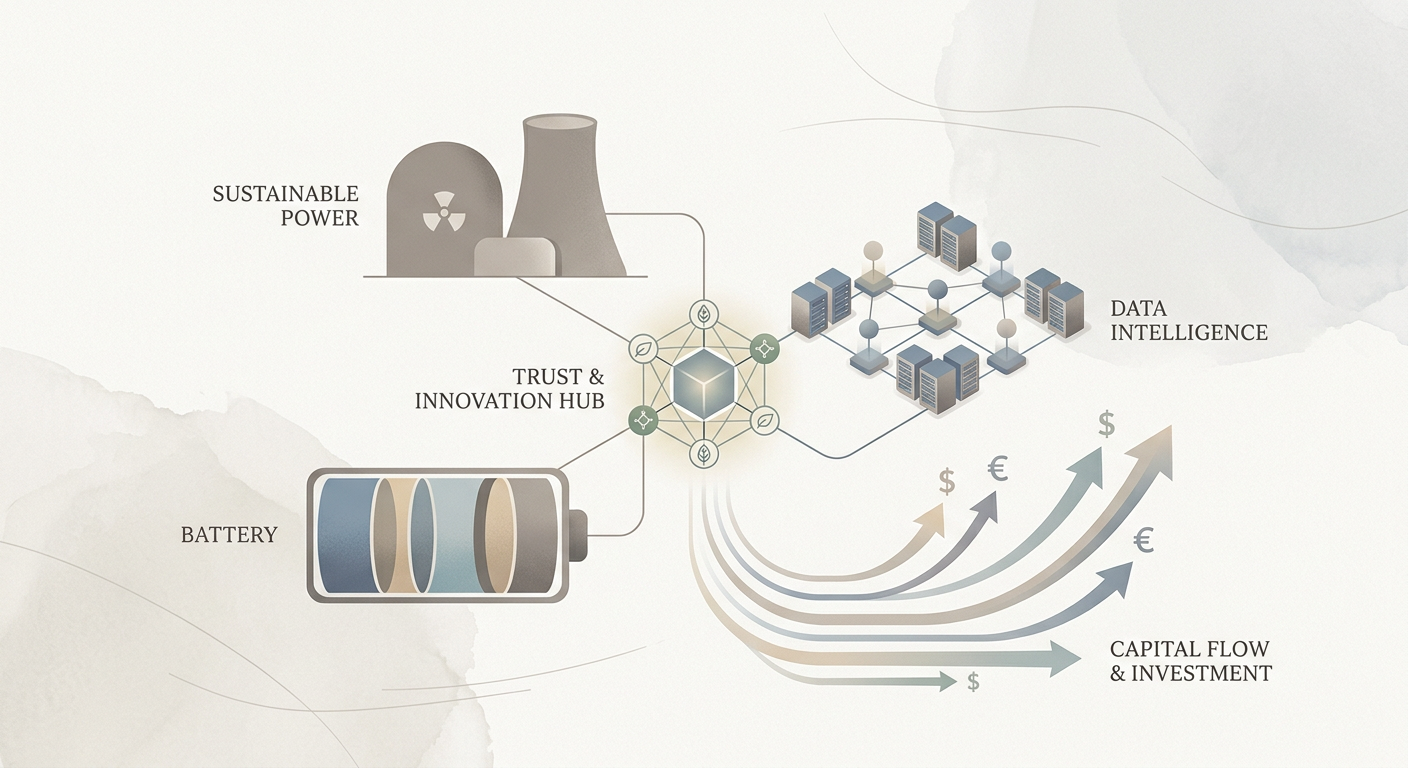

Новая Siri, запланированная на iOS 26.4 (весна 2026, март-апрель), будет состоять из трёх основных компонентов:

- Query Planner — понимает естественный язык и намерение пользователя. Будет работать на Google Gemini

- Knowledge Search — ищет информацию о мировых событиях, людях, фактах в реальном времени. Также на Gemini

- Summarizer — преобразует результаты поиска в понятный и естественный ответ. И снова Gemini

Ключевой момент архитектуры: Google модели будут работать на серверах Apple, а не отправляться в облако Google. Apple маркирует это как "Private Cloud Compute" — технику, которая позволяет обрабатывать запросы конфиденциально, используя вычислительную инфраструктуру Google, но под полным контролем Apple. Это означает, что запросы не передаются в Google Cloud и не используются для обучения моделей Google.

Для персональных данных (фото, переписка, календарь, заметки) Apple будет использовать собственные Foundation Models, запускаемые полностью на устройстве пользователя. Так что, когда ты спросишь "найди рекомендацию книги от мамы", Siri будет анализировать твои письма локально на iPhone, а затем использовать Gemini для генерации естественного ответа.

Google Gemini с 1.2 триллионами параметров — это модель, которая лучше справляется с рассуждениями, понимаем контекста и логики, чем собственные системы Apple. Вместо вложения миллиардов долларов в разработку конкурирующей модели (что потребует лет разработки и гарантирует отставание), Apple выбирает прагматичный путь: используй лучшее, что уже существует на рынке, интегрируй это в свой контроль приватности, маркируй как собственное решение для конечного пользователя.

Этот подход напоминает то, что делает Samsung с Galaxy AI (с 2024 года): большинство "Galaxy AI" функций — это интеграция Google Gemini под Samsung UI. Samsung также скрывает источник моделей от конечного пользователя.

Что это означает для отрасли и конкуренции

В 2023-2024 годах казалось, что будущее AI — это война между мегакорпорациями за монополию на Language Models. OpenAI vs. Google vs. Meta vs. Apple vs. Microsoft. Каждый разрабатывает свою модель, каждый пытается заблокировать доступ конкурентов и захватить рынок.

Но реальность оказалась прагматичнее: никто не может быть лучшим во всём одновременно. Вот новая расстановка сил по специализации:

- Google лучше в рассуждениях и контекстном понимании (Gemini 1.2T)

- DeepSeek (китайская компания) лучше в cost-efficiency (модели обучены за $6М)

- Meta лучше в масштабируемости open-source (Llama)

- OpenAI лучше в пользовательском опыте и интерфейсах (ChatGPT, Canvas)

- Apple лучше в приватности и интеграции с экосистемой

Вместо войны складывается экосистема специализации и партнёрств. Это означает, что конкуренция теперь идёт не за создание универсальной "лучшей" модели, а за контроль над точками входа в сеть: телефоны, браузеры, голосовые ассистенты, поисковые системы. Кто контролирует interface к AI — тот контролирует рынок, не важно, чья модель работает внутри.

Практические сценарии для бизнеса

Для SaaS-компаний, работающих с Apple: Если вы строили интеграцию с Siri API (например, бронирование рейсов, заказ услуг), готовьтесь к расширению возможностей. Новая Siri на базе Gemini сможет запускать намного более сложные операции, анализируя контекст из разных источников. Это расширит спектр того, что можно автоматизировать через голосовую команду.

Для компаний, работающих с Google Gemini API: Это подтверждение, что Gemini модели не только конкурентоспособны, но выбраны даже в закрытых экосистемах Apple, которые обычно используют только собственные технологии. Google заработает миллиарды на лицензировании Gemini для Apple, Microsoft, Samsung и других. Будущие контракты будут стимулировать интеграцию Gemini API в enterprise-системы.

Для разработчиков AI и стартапов: Сигнал ясен: не пытайтесь построить универсальную модель. Специализируйтесь — на рассуждениях, на скорости обучения, на cost-efficiency, на приватности. Рынок вознаграждает узкую экспертизу и глубокие компетенции. Интеграция между специализированными системами становится ключевой компетенцией, а не разработка одной "всемогущей" модели.

Для CTO и ITiD корпораций: Это сигнал того, как должна выглядеть ваша AI-архитектура: не "какую одну модель купить?", а "как интегрировать компоненты от разных лучших поставщиков?" — Gemini для рассуждений, OpenAI для интерфейсов, proprietary модели для конфиденциальных данных.

Не рекламируется. Apple официально не будет рекламировать использование Google Gemini. Функционально новая Siri будет маркирована как "Apple Intelligence" на всех материалах и в UI. Это означает, что большинство пользователей могут не осознавать, что часть обработки идёт через Google Gemini, потенциально нарушая ожидания относительно приватности и контроля (хотя данные остаются на серверах Apple).

Геополитический риск. Зависимость Apple от Google для AI-функций создаёт критический геополитический риск: что если отношения между американскими компаниями испортятся, или США введут дополнительные санкции/регуляции, или Google столкнётся с судебными исками? В худшем случае Apple потеряет контроль над критическими функциями Siri.

Конкурентное преимущество OpenAI ослаблено. OpenAI получит меньше интеграций через Apple, чем мог бы рассчитывать ещё год назад. Переговоры между Apple и OpenAI могут усложниться или даже развалиться.

Таймлайн: что отслеживать в ближайшие 18 месяцев

Ноябрь 2025 — январь 2026: Первые слухи о проблемах или успехах интеграции Gemini в iOS 26. Испытатели и developers получают доступ к бета-версиям.

Март-апрель 2026 (Q1 2026): Apple официально анонсирует iOS 26.4 с новой Siri на WWDC 2026 или в отдельном press-releaseе. Первые реальные тесты покажут, насколько хорошо интеграция Google Gemini работает на практике по сравнению с конкурентами.

Q2-Q3 2026: Другие компании (Microsoft, Meta, Amazon) будут вынуждены сделать выбор: либо интегрировать конкурирующие модели (OpenAI, Gemini, DeepSeek), либо инвестировать десятки миллиардов в разработку собственных моделей world-class. История ставит на то, что интеграция и партнёрства выиграют.

2026-2027: Возможные судебные иски или переговоры между OpenAI и Apple, если интеграция Gemini будет лучше работать. Или, наоборот, Apple начнёт переговоры о интеграции ChatGPT для нишевых функций (например, для image generation).

2026-2027+: Первые сигналы о том, какой model выигрывает в smartphone assistant race — Gemini, ChatGPT, Llama или что-то совсем новое.

Узнать больше

Bloomberg: Apple Plans to Use 1.2 Trillion Parameter Google Gemini Model

Оригинальная новость от Bloomberg об Apple, выбирающей Google Gemini 1.2T для iOS 26.4 Siri

9to5Mac: Technical Analysis of New Siri Architecture with Private Cloud Compute

Детальный анализ трёхкомпонентной архитектуры новой Siri, Private Cloud Compute и работы Gemini

Apple WWDC 2024 Press Release: Apple Intelligence Introduction (June 2024)

Официальный пресс-релиз Apple об анонсе Apple Intelligence с OpenAI partnership

Ключевые выводы для действия

Если вы работаете в AI-стартапе: Специализируйтесь в узких компетенциях, не пытайтесь быть универсальным. Google Gemini доминирует в рассуждениях, OpenAI в интерфейсах, DeepSeek в cost-efficiency — найдите вашу нишу, где вы можете быть лучше всех.

Если вы работаете в enterprise или корпоративной разработке: Начните думать об AI-архитектуре не как о "какую одну модель купить?", а как "как интегрировать лучшие компоненты от разных поставщиков при сохранении приватности и контроля?". Apple и Samsung только что показали, что это путь будущего.

Если вы инвестор: Следите за новостями о расширении Gemini API (Google заработает миллиарды), интеграциями AI в OS (apple, Samsung, Microsoft), и специализированными AI-компаниями, решающими узкие проблемы лучше, чем генерализированные модели.

Источники и факт-чек

Материал подготовлен на основе: официальных пресс-релизов Bloomberg (5 ноября 2025), публикаций 9to5Mac (Mark Gurman, 3 ноября 2025), Reuters (5 ноября), Android Police (3 ноября), Apple Press Release (WWDC 2024, 9-10 июня). Данные о Google Gemini 1.2T параметров, iOS 26.4, Private Cloud Compute перепроверены по официальным источникам. Статья актуальна на 5 ноября 2025 года.