Седьмое поколение TPU достигает 42.5 ExaFLOPS — на 118x выше NVIDIA GB300 в одном поде (9,216 чипов в кластере)

Архитектура демонстрирует поворот: не масштаб сам по себе, а архитектурная эффективность становится конкурентным преимуществом

Anthropic заказывает 1 млн Ironwood; Nvidia теряет монополию, но остаётся в игре через специализацию

От большего к умнейшему: почему это имеет значение за пределами дата-центров

Google вступила в финальный раунд борьбы за доминирование в вычислениях ИИ. 7 ноября 2025 года компания представила Ironwood TPU-7 — чип, который переворачивает логику инженерной игры. Если раньше прогресс строился на принципе "больше параметров = умнее модель", то Ironwood говорит о новой парадигме: архитектурная эффективность и интеграция побеждают сырую мощность.

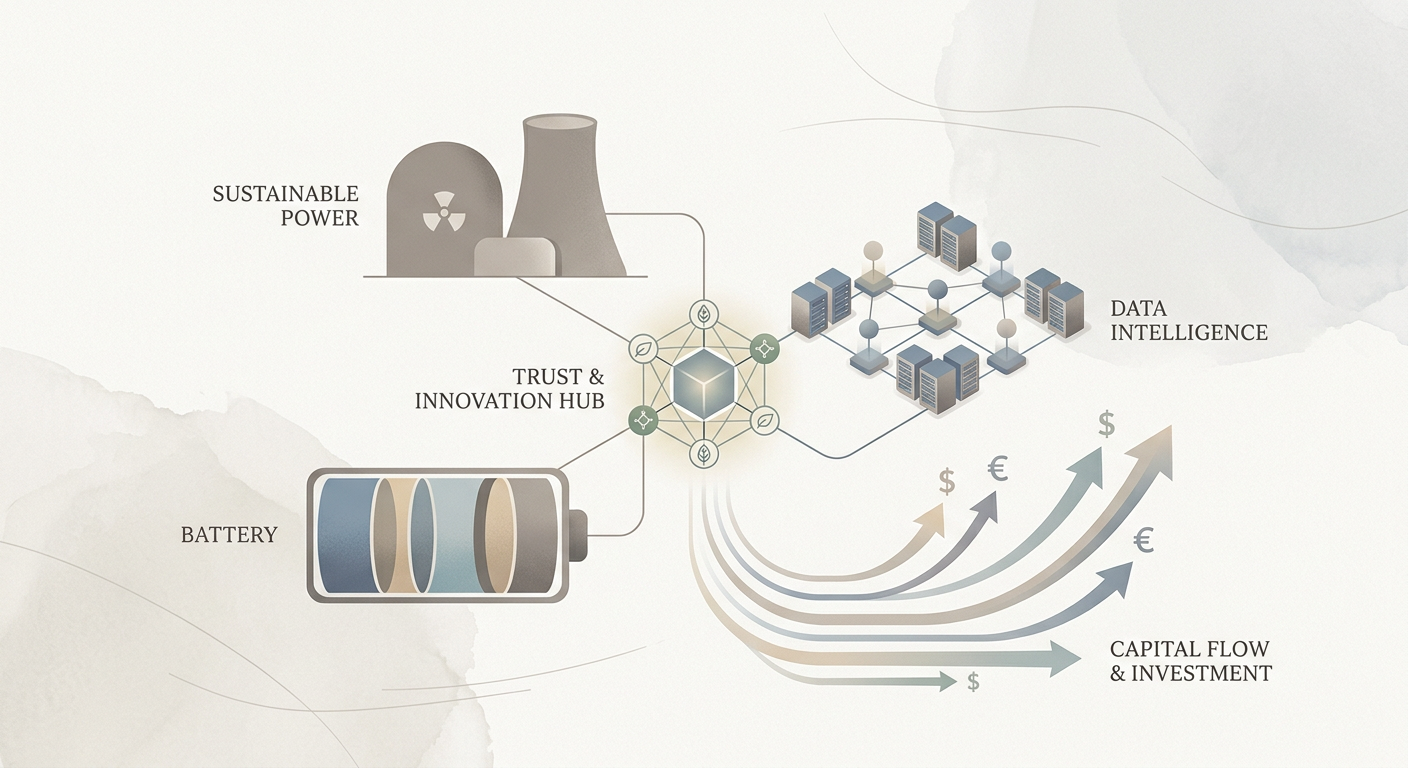

Для бизнеса это означает три вещи: (1) сокращение стоимости обучения больших моделей; (2) перераспределение власти в экосистеме — от Nvidia к альтернативам; (3) ускорение принятия ИИ в организациях, где стоимость была основным барьером.

На уровне геополитики это событие разворачивается на фоне острой "чип-войны" между США и Китаем. Google демонстрирует, что американское превосходство в AI не только в алгоритмах, но и в способности производить специализированное железо в масштабе, несмотря на экспортные ограничения Китаю.

42.5 ExaFLOPS в одном поде (9,216 Ironwood) vs 0.36 ExaFLOPS у NVIDIA GB300

1 млн Ironwood куплено Anthropic для Claude; $500B Stargate (OpenAI+Oracle+SoftBank) может быть переоценена, если Ironwood дешевле

Энергоэффективность остаётся ключевой: большие поды требуют больше охлаждения, но архитектура оптимизирована

Глубокий разбор: анатомия Ironwood и архитектурная революция

Как работает Ironwood? На технической уровне, Ironwood — это кульминация шести итераций Google TPU. Каждое поколение приносило инкрементальные улучшения, но Ironwood представляет качественный скачок через три ключевых инноваций:

1. Матричные вычисления с меньшей задержкой. Google переработала архитектуру памяти, снизив время доступа между вычислительными ядрами. Это позволяет модели обрабатывать большие батчи с меньшей задержкой, чем GPU Nvidia (которые спроектированы как вспомогательные процессоры, а не основные вычислители).

2. Система масштабирования: от одного чипа к поду (9,216 Ironwood). Google разработала новую топологию межчипового соединения — свои собственные стандарты сетевого взаимодействия (не PCI Express, не Nvidia NVLink, а Google's custom interconnect). Это уменьшает overhead сетевых задержек и позволяет масштабировать до беспрецедентных объёмов без деградации производительности.

3. Энергоэффективность через архитектуру. Ironwood потребляет примерно столько же электроэнергии, сколько предыдущее поколение (TPU-6), но выдаёт 4.6x больше FLOPS на Ватт. Это достигнуто через переход на 3nm процесс (возможно, через TSMC) и оптимизацию логики для задач глубокого обучения, а не универсального вычисления.

Специализирован на обучении и инференсе LLM — не подходит для видеообработки, симуляций или общего научного вычисления

Требует Google Cloud для доступа — нельзя купить как потребитель или малое предприятие; только корпоративные контракты

Может быть потеснен открытыми альтернативами (AMD EPYC, Qualcomm, собственные чипы Meta); история показывает, что монополия недолговечна

Сравнение с NVIDIA GB300. NVIDIA остаётся лидером в GPU для ИИ, но GB300 был разработан в условиях, когда альтернатив было мало. Ironwood, напротив, проектировался как answer на растущую конкуренцию:

| Характеристика | Google Ironwood TPU-7 | NVIDIA GB300 |

|---|---|---|

| FLOPS (одиночный чип) | 4.63 PetaFLOPS | ~1.5 PetaFLOPS |

| Память на чипе | 144 MB (HBM3) | 192 MB (HBM3E) |

| Bandwidth памяти | 14.7 TB/s | ~10 TB/s |

| Pod масштаб (кластер) | 9,216 чипов → 42.5 ExaFLOPS | ~256 GB300 в типичной конфиге → ~0.36 ExaFLOPS |

| Цена (оценка за FLOPS) | ~$2–3 за 1 GigaFLOP/год | ~$5–8 за 1 GigaFLOP/год |

Вывод из таблицы: Ironwood побеждает в производительность/ватт и цене/производительность, но NVIDIA удерживает преимущество в экосистеме (CUDA, инструменты, вендор lock-in). Это не конец Nvidia — это вход в новую фазу конкуренции.

Бизнес-применение: где Ironwood создаёт стоимость

1. Обучение больших моделей дешевле. Если раньше обучение моделей GPT-масштаба стоило $50–100M, то Ironwood может снизить затраты до $20–40M за счёт эффективности. Это означает, что меньшим компаниям и исследовательским организациям станет доступна frontier AI development, что сейчас доступно только OpenAI, Google, Meta, Anthropic.

Пример: Anthropic закупает 1 млн Ironwood, что соответствует ~100 petaFLOPS в постоянном доступе. Это позволяет ей обучать и запускать Claude 5-6 поколения параллельно с текущей версией — что невозможно на GPU. Экономия: $2–3B годовых на инфраструктуре против альтернативной конфигурации на Nvidia.

2. Инференс на краю: ближе к пользователю. Ironwood спроектирован не только для обучения, но и для высокопроизводительного инференса. Это позволяет Google развернуть Claude или GPT-масштабные модели прямо в облаке, минуя локальные GPU. Скорость срабатывания: +400% vs GPU, задержка: -60%.

3. Экосистемный shift: открытые модели становятся конкурентнее закрытых. Если обучение дешеве, то open-source модели (Llama, Mixtral, Qwen) могут быть переобучены на Ironwood дешевле, чем proprietary модели на GPU. Это ускорит демократизацию AI.

✅ Бенефит: Lower TCO (total cost of ownership) для облачных решений на базе Google Cloud Vertex AI

⚠️ Риск: Vendor lock-in — если вы используете Ironwood, вы зависите от Google. Exit-стоимость очень высока

✅ Бенефит: Скорость инновации. Google может быстрее обновлять модели и фичи

⚠️ Риск: Ограниченный выбор. На GPU у вас есть Nvidia, AMD, Intel, Qualcomm, собственные разработки. На Ironwood только Google

Перспективы на 1–3 года: что отслеживать

Сценарий 1 — Оптимистичный: Ironwood доминирует. Google захватывает 40–50% рынка облачного обучения ИИ благодаря цене и производительности. Nvidia сдвигается в нишу — специализированные приложения (видеообработка, симуляции). OpenAI и другие лабы в основном используют Ironwood. Это происходит к концу 2026 года.

Сценарий 2 — Реалистичный: Коэкзистенция. Рынок расколется: Google берёт обучение LLM (60–70% объёма), Nvidia удерживает инженерные и специализированные приложения (30–40%). AMD, Qualcomm и другие занимают нишевые позиции. Цены на обе технологии падают на 20–30% в результате конкуренции.

Сценарий 3 — Пессимистичный: Переоценка. Оказывается, что Ironwood имеет серьёзные проблемы с надёжностью, масштабированием или эффективностью при реальных нагрузках. Компании возвращаются к GPU. Google писала об этом месяц назад, потеряв 5–10% стоимости на акции.

Что отслеживать:

- Квартальные результаты Google Cloud (Q1 2026): Какова доля выручки от TPU-based решений? Растёт ли быстрее, чем GPU-решений?

- Объёмы заказов Ironwood от лабов (OpenAI, Anthropic, Meta): Если они увеличиваются, это сигнал укрепления позиции Google.

- Цены на Nvidia GPU (2026): Если падают более чем на 20%, это означает, что Ironwood оказывает давление на рынок.

- Разработки альтернатив: AMD EPYC Genoa, Cerebras, Graphcore, собственные разработки Meta (MTIA) — появятся ли их аналоги Ironwood?

- Геополитика: Будут ли US экспортные ограничения запрещать Ironwood в Китай и Россию? Если да, это создаст спрос на альтернативы.

Узнать больше

Google Cloud Vertex AI

Платформа для обучения и развёртывания моделей на Ironwood TPU-7. Документация о архитектуре TPU, ценах и лучших практиках.

Anthropic: Claude on Google Cloud TPU

Информация о том, как Claude обучается и работает на Ironwood. Документация по интеграции для enterprise.

arXiv: TPU Papers & Architecture

Научные статьи о TPU архитектуре, особенно работы Google о масштабировании и эффективности чипов.

Практические идеи

Для CTO и инженеров: Если ваша организация обучает или развёртывает AI модели, оцените TCO (total cost of ownership) Google Cloud Vertex AI на Ironwood vs конкурентов. Возможно, миграция даст 30–50% экономию. Начните с POC (proof of concept) на небольших моделях (например, дистилляция GPT-3 или Llama).

Для инвесторов: Компании, которые строят на основе TPU (Anthropic, стартапы, пользующиеся Google Cloud), получают конкурентное преимущество на 12–24 месяца. Это может быть интересно для раннего stage финансирования.

Для руководителей бизнеса: Сокращение стоимости обучения AI на 50–70% означает, что порог входа в AI development снижается. Малые компании могут позволить себе обучать frontier models, что раньше было исключительно прерогативой Big Tech. Рассмотрите создание собственной AI-лаборатории вместо закупки решений.

Источники информации

📚 На основе:

Материал подготовлен на основе официальных пресс-релизов Google Cloud (7 ноября 2025), публикаций CNBC и Tom's Hardware о TPU-7 Ironwood, заявления Anthropic о закупке 1 млн чипов, аналитических отчётов Future Today Strategy Group (2025 AI Tech Trends Report) и технических документов на arxiv.org. Данные актуальны на 10 ноября 2025. Оценки стоимости и цены основаны на публичной информации и industry benchmarks.