Google нужно увеличивать serving capacity в 1000 раз за 4-5 лет — это не про обучение моделей, а про обслуживание растущего потока пользователей Gemini и Google Cloud

Узкое место — не амбиции, а физические ограничения: электроэнергия, охлаждение, пропускная способность сетей и время строительства дата-центров

Индустрия входит в «стадию два AI», где serving capacity важнее compute capacity — модель создана, но нужна инфраструктура для её массового применения

Когда вице-президент Google Амин Вахдат заявил на внутреннем совещании 6 ноября, что компании необходимо удваивать serving capacity каждые шесть месяцев, это прозвучало не как амбициозная цель, а как описание неизбежной реальности. Google, как и другие гипермасштабируемые облачные провайдеры, столкнулась с фундаментальным сдвигом в архитектуре AI-инфраструктуры: спрос на использование моделей растёт быстрее, чем способность их обслуживать.

От compute к serving: новая фаза AI-индустрии

Serving capacity — это способность инфраструктуры обрабатывать запросы пользователей к уже обученным моделям в режиме реального времени. Это фундаментально отличается от compute capacity, которая определяет, сколько вычислительных ресурсов доступно для обучения новых моделей. В 2023-2024 годах все гипермасштабируемые провайдеры — Google Cloud, Amazon AWS, Microsoft Azure — наращивали compute в ожидании взрывного роста числа AI-пользователей. Теперь пользователи пришли, и проблема сместилась.

«Мы входим во вторую стадию развития AI, где serving capacity имеет даже большее значение, чем compute capacity, потому что compute создаёт модель, но serving capacity определяет, насколько широко и быстро эта модель может достичь пользователей», — объясняет Шей Болор, главный рыночный стратег Futurum Equities. Это не просто технический нюанс: различие между обучением модели и её использованием определяет, кто из игроков сможет масштабироваться в ближайшие годы.

Представитель Google уточнил, что «спрос на AI-сервисы означает, что нас просят предоставить значительно больше вычислительных мощностей, которые мы обеспечиваем через повышение эффективности на уровне аппаратного обеспечения, программного обеспечения и оптимизации моделей, помимо новых инвестиций». В качестве примера компания указывает на чипы Ironwood — собственные TPU шестого поколения, представленные на Hot Chips 2025.

Ironwood TPU: 42,5 экзафлопс и энергоэффективность

Google Ironwood TPU — это не просто очередная итерация тензорных процессоров. Архитектура масштабируется до 9 216 чипов в одном узле (SuperPod), обеспечивая до 42,5 экзафлопс производительности. При этом один узел потребляет до 10 МВт электроэнергии — эквивалент небольшого города. Ключевое достижение — двукратное улучшение энергоэффективности (perf-per-watt) по сравнению с предыдущим поколением Trillium.

Ironwood использует HBM3e память, улучшенные межсоединения для масштабирования до десятков SuperPods и оптическую коммутацию цепей (OCS), которая позволяет динамически реконфигурировать кластеры при отказах узлов, восстанавливаясь из контрольных точек. Что особенно показательно: AI использовался для проектирования самих чипов — команда AlphaChip оптимизировала схемы ALU и компоновку кристалла. Это замкнутый цикл: AI создаёт инструменты для собственного масштабирования.

Но даже с такими чипами Google сталкивается с физическими ограничениями. «Узкое место — не амбиции, а именно физические ограничения: электроэнергия, охлаждение, пропускная способность сетей и время, необходимое для строительства дата-центров с достаточной мощностью», — отмечает Болор. McKinsey прогнозирует, что спрос на AI-готовые мощности дата-центров будет расти в среднем на 33% в год до 2030 года, причём около 70% всех мощностей будут предназначены для AI-рабочих нагрузок.

Физические ограничения инфраструктуры

Средняя плотность мощности стоек дата-центров удвоилась за два года — с 8 кВт до 17 кВт на стойку, и ожидается рост до 30 кВт к 2027 году. Обучение моделей уровня ChatGPT требует более 80 кВт на стойку, а новейший чип Nvidia GB200 в связке с серверами может потреблять до 120 кВт на стойку. Охлаждение традиционными воздушными системами становится невозможным: на него приходится 38-40% всего энергопотребления дата-центра.

Жидкостное охлаждение на уровне чипа (direct-to-chip liquid cooling) снижает энергопотребление на охлаждение до 40% по сравнению с воздушным охлаждением и поддерживает плотности 50-100 кВт на стойку. По данным Deloitte, жидкостные системы могут сократить энергопотребление на 90% по сравнению с воздушными системами. Но интеграция таких технологий требует времени — строительство и оснащение дата-центра занимает 18-36 месяцев, что создаёт структурную задержку между спросом и предложением.

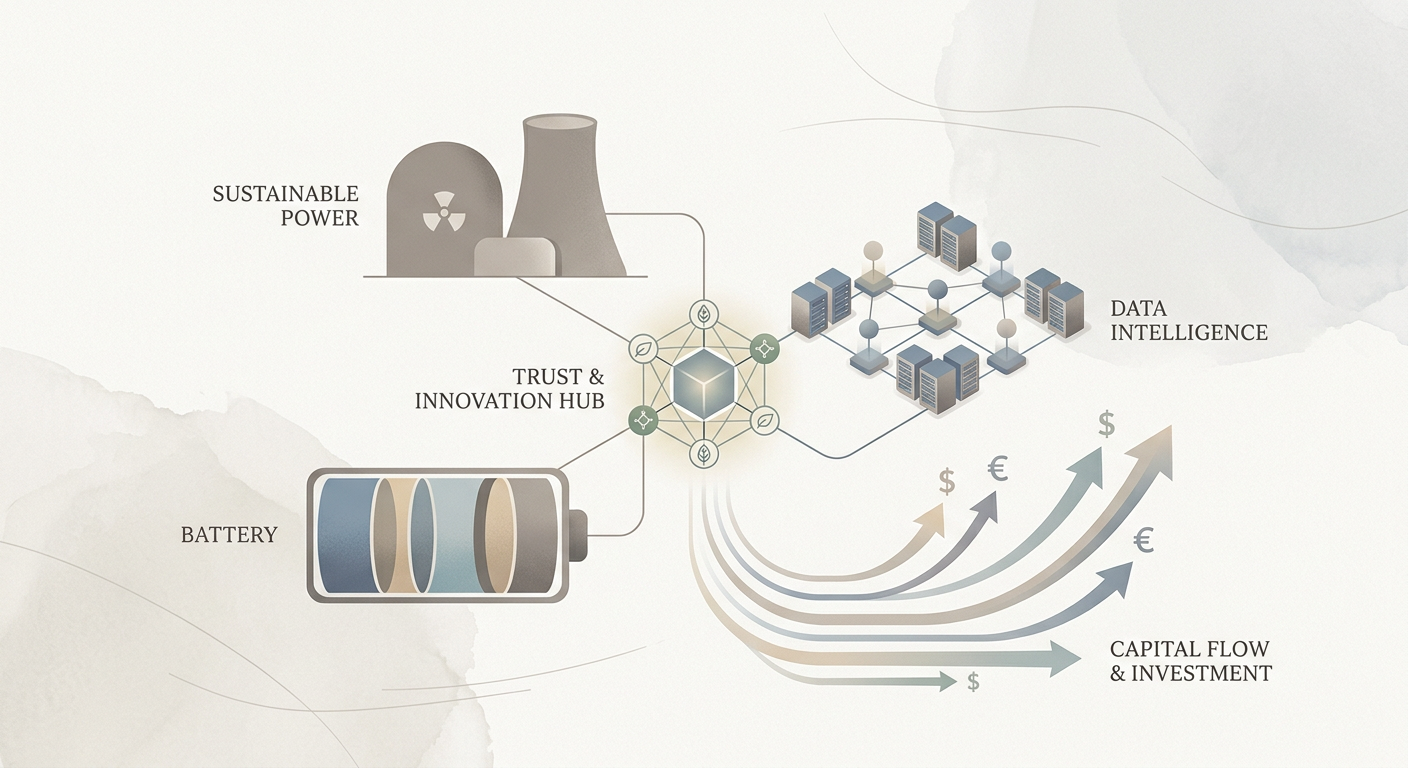

Доступность электросетей становится первичным ограничением. В регионах с высокой плотностью дата-центров — Северная Вирджиния (США), Лондон, Франкфурт — сетевая инфраструктура уже не справляется с запросами на новые подключения. Это толкает гипермасштабируемых провайдеров искать альтернативные источники энергии: от солнечных ферм и батарей (Google в Техасе) до малых модульных ядерных реакторов (проекты в Теннесси и Техасе).

Спрос против пузыря: сигнал рынку

Заявление Google о необходимости удваивать serving capacity каждые шесть месяцев может показаться гиперболой на фоне опасений о пузыре AI, которые в конце ноября обрушили все три основных фондовых индекса США на 1,9% и более. Но Болор видит в этом противоположный сигнал: «Это не спекулятивный энтузиазм, это неудовлетворённый спрос, стоящий в очереди. Если что-то замедляется больше, чем многие надеются, то потому что все ограничены в compute и serving capacity».

Иными словами, проблема не в отсутствии спроса на AI-сервисы, а в неспособности инфраструктуры масштабироваться достаточно быстро. Google Cloud, Gemini и другие продукты компании сталкиваются с всё более сложными запросами — расширенный поиск, генерация и анализ видео, мультимодальные задачи. Каждый из этих сценариев требует на порядки больше ресурсов, чем простые текстовые запросы первого поколения LLM-приложений.

Для контекста: GPT-4 содержит, по оценкам, 1,76 триллиона параметров и требует сотен петафлопс для обучения. Но inference (использование модели) для миллионов одновременных пользователей требует распределённой инфраструктуры с низкими задержками, избыточностью и эластичностью. Это принципиально иная архитектурная задача, чем создание training cluster.

Для CTOs: Пересмотрите стратегии закупки инфраструктуры — фокус смещается с GPU-кластеров для обучения на масштабируемую inference-инфраструктуру с низкими задержками

Для инвесторов: Компании, специализирующиеся на serving capacity (GPU-as-a-Service провайдеры типа CoreWeave), охлаждении и энергоэффективности, становятся критическими звеньями цепочки

Для продуктовых команд: Оптимизация моделей для inference (дистилляция, квантизация, pruning) становится не опциональной, а обязательной практикой для масштабирования

Цель: рост в 1000 раз за пять лет

Цель Google — увеличить serving capacity в 1000 раз за 4-5 лет — это не маркетинговая метрика. Это инженерная roadmap, требующая координации на всех уровнях: от проектирования чипов и оптимизации моделей до строительства дата-центров и переговоров с энергетическими компаниями. И Google не одинока: Amazon AWS, Microsoft Azure, Meta, и облачные GPU-провайдеры типа CoreWeave сталкиваются с теми же вызовами.

Вторая стадия AI — это не про создание всё более крупных моделей, а про то, чтобы сделать существующие модели доступными миллиардам пользователей с приемлемыми задержками и затратами. Это инфраструктурная гонка, где победители определятся не количеством параметров в модели, а способностью масштабировать serving capacity быстрее конкурентов. Google заявила о своих амбициях публично — теперь индустрия наблюдает, смогут ли физические законы и инженерные решения поспеть за спросом.

Google Cloud Infrastructure: Документация по Google Ironwood TPU и архитектуре SuperPods — cloud.google.com/tpu

McKinsey AI Infrastructure Report: Полный анализ роста спроса на AI-готовые дата-центры до 2030 года — mckinsey.com/ai-power-expanding-data-center-capacity

Hot Chips 2025 Conference: Технические презентации Google Ironwood и других AI-ускорителей нового поколения — hotchips.org

Источники

- Fortune, "As Google eyes exponential surge in serving capacity, analyst says we're entering 'stage two of AI'", November 23, 2025

- CNBC, "Google must double AI serving capacity every 6 months to meet demand", November 21, 2025

- Gizmodo, "Google Exec Claims Company Needs to Double Its AI Serving Capacity Every Six Months", November 21, 2025

- Serve The Home, "Google Ironwood TPU Swings for Reasoning Model Leadership at Hot Chips 2025", August 26, 2025

- McKinsey & Company, "AI power: Expanding data center capacity to meet growing demand", October 28, 2024

- Deloitte Research, "Liquid cooling technologies for hyperscale data centers", 2024

- Hanwha Data Centers, "Sustainable Energy Solutions for Hyperscale Data Centers", September 16, 2025