TPU от Google обеспечивают в 2–3 раза более высокую энергоэффективность по сравнению с GPU, достигая 30-кратного улучшения за девять поколений. Это снижает стоимость обучения больших языковых моделей на 20–30%.

GPU сохраняют доминирующую позицию с 80% рынка благодаря универсальности и поддержке всех основных фреймворков, от PyTorch до TensorFlow, что делает их незаменимыми для научных расчётов и смешанных рабочих нагрузок.

Рынок AI-ускорителей вырастет с $140 млрд в 2025 до $440 млрд к 2030 году при темпе роста 25% в год, создавая новые возможности для гибридных архитектур, объединяющих преимущества специализированных и универсальных процессоров.

Война архитектур: матричная математика против универсальности

Когда нейросеть GPT-4 просчитывает ответ на ваш вопрос, за долю секунды происходят триллионы математических операций. Кто выполняет эту невидимую работу? За последнее десятилетие индустрия искусственного интеллекта разделилась на два лагеря: сторонников универсальных графических процессоров (GPU) и приверженцев специализированных тензорных ускорителей (TPU). Выбор между ними определяет не только скорость обучения моделей, но и энергопотребление дата-центров, стоимость облачных вычислений и даже геополитический баланс в гонке технологий.

GPU родились в индустрии видеоигр, где требовалось одновременно обрабатывать миллионы пикселей. Инженеры NVIDIA в 2006 году открыли их для общих вычислений, создав платформу CUDA. Сегодня флагманский H100 содержит более 10 тысяч программируемых ядер, 80 ГБ сверхбыстрой памяти и пропускную способность 3,35 терабайт в секунду. Эта архитектура позволяет запускать любой код — от рендеринга спецэффектов до обучения нейросетей.

TPU выбрали иной путь. Вместо тысяч универсальных ядер Google создал систолические массивы — специализированные схемы, где данные перетекают по сетке вычислительных элементов подобно сердечному ритму. Каждый элемент выполняет одну операцию — умножение и накопление матриц, ключевую для нейросетей. Первый TPU появился в 2016 году для вывода результатов обученных моделей. Нынешнее поколение Ironwood оперирует 192 ГБ памяти с пропускной способностью 7,2 ТБ/с — вдвое больше, чем у H100. Кластеры из 9216 чипов достигают 42,5 эксафлопс — вычислительной мощности, превосходящей большинство суперкомпьютеров планеты.

GPU обрабатывают код последовательно, распределяя тысячи потоков по ядрам. TPU выполняют матричные операции параллельно через систолический массив, где каждый такт данные перетекают синхронно через все элементы. Это как разница между оркестром, где музыканты импровизируют, и часовым механизмом, где каждая шестерёнка движется в строгом ритме.

Разница проявляется в цифрах. TPU v4 выдаёт 275 терафлопс, GPU A100 — 156. Но реальное преимущество TPU — в энергоэффективности. На каждый ватт энергии они выполняют в 2–3 раза больше операций, чем современные GPU. Ironwood в 30 раз эффективнее первого поколения 2016 года. Для компаний, чьи дата-центры потребляют мегаватты энергии, это означает снижение счетов за электричество на десятки миллионов долларов.

Где побеждает специализация, где — универсальность

DeepMind использовала TPU для обучения AlphaFold — системы, предсказывающей структуру белков. Модель обработала 200 миллионов белковых последовательностей за месяцы вместо десятилетий традиционных методов. Google обучил языковую модель PaLM на 540 миллиардах параметров, задействовав 6144 TPU v4. Себестоимость обучения оказалась на 20–30% ниже, чем на GPU-кластерах сопоставимой мощности.

Однако GPU сохраняют 80% рынка AI-ускорителей. Причина — гибкость. Исследователь в университетской лаборатории может написать экспериментальный алгоритм на PyTorch, запустить его на локальной GPU-станции, а затем перенести в облако Amazon или Microsoft Azure. TPU доступны только через Google Cloud и оптимизированы для TensorFlow. Переход требует переписывания кода под компилятор XLA — нетривиальная задача для команд, привыкших к PyTorch.

TPU показывают лучшую цену-производительность для TensorFlow-проектов: ByteBridge фиксирует в 4–10 раз меньшие затраты на обучение больших языковых моделей по сравнению с A100. Но привязка к Google Cloud означает отсутствие контроля над аппаратурой и зависимость от одного поставщика. GPU можно купить или арендовать у десятков провайдеров — от AWS до локальных дата-центров.

Существует ещё один класс задач, где GPU незаменимы: научное моделирование. Климатические прогнозы, симуляции молекулярной динамики, расчёты квантовой химии требуют двойной точности (64-битные числа). TPU оптимизированы под bfloat16 — 16-битный формат, достаточный для нейросетей, но непригодный для физических симуляций. Суперкомпьютер Frontier использует GPU AMD MI250X именно по этой причине.

Экономика чипов и стратегия бизнеса

Для стартапа, разрабатывающего компьютерное зрение, выбор архитектуры — вопрос выживания. GPU-серверы с 8 картами A100 стоят $200 тысяч. Аренда в облаке — $2,50–3 за час GPU. TPU v4 в Google Cloud — $1,35 за час, но требует переписывания пайплайнов данных. Компании часто начинают с GPU для прототипирования, затем переходят на TPU для масштабного обучения, если используют TensorFlow.

Крупные корпорации выбирают гибридную стратегию. Meta обучает рекомендательные системы на собственных GPU-кластерах с модифицированным PyTorch, сохраняя контроль над инфраструктурой. OpenAI использовала 10 тысяч GPU A100 для GPT-3, но тесты показывали, что TPU v4 могли бы снизить стоимость на 25%. Компромисс не принят из-за зависимости кодовой базы от CUDA.

| Критерий | GPU (H100) | TPU (Ironwood) |

|---|---|---|

| Производительность | 156–275 TFLOPS | 275–460 TFLOPS |

| Память | 80 ГБ HBM3 | 192 ГБ HBM |

| Пропускная способность | 3,35 ТБ/с | 7,2 ТБ/с |

| Энергоэффективность | Базовая | 2–3× выше |

| Экосистема | CUDA, PyTorch, TensorFlow | TensorFlow, JAX, XLA |

| Доступность | Покупка + аренда (AWS, Azure, GCP) | Только Google Cloud |

| Цена обучения LLM | $1,0 (относительная) | $0,6–0,8 |

Мы обучали языковую модель на 70 миллиардах параметров. GPU давали гибкость в отладке, но TPU снизили время обучения на 40% и затраты на 30%. Переход потребовал переписать загрузку данных, но окупился за первый же запуск.— Инженер машинного обучения крупной технологической компании, интервью Wevolver

Технологическая гонка и будущее архитектур

NVIDIA представит линейку Blackwell B100 в 2025 году с обещанием 2–3-кратного роста производительности над Hopper H100. Чипы получат интегрированные блоки для трассировки лучей и AI-ускорители, размывая границу между графикой и вычислениями. Google анонсировал Trillium v2 с удвоенной мощностью TPU v4 и 2,5-кратным улучшением энергоэффективности. Edge TPU сжимаются до размеров, позволяющих встраивать их в смартфоны и автономные дроны.

Появляются гибридные решения. AMD MI300 объединяет GPU-ядра с тензорными ускорителями на одном кристалле. Intel Gaudi3 копирует архитектуру TPU, но поддерживает PyTorch изначально, устраняя барьер экосистемы. Китайские производители Huawei Ascend и Alibaba Hanguang создают собственные альтернативы, пытаясь обойти санкции на поставки NVIDIA.

Рынок AI-ускорителей вырастет со $140,55 млрд в 2025 до $440,3 млрд к 2030 году (CAGR 25%). NVIDIA удерживает 80% рынка GPU. Доля TPU вырастет с 3–4% до 5–6%, в основном за счёт облачных inference-задач и обучения сверхбольших моделей в Google Cloud.

Ключевой драйвер роста — гибридные архитектуры, сочетающие программируемость GPU с эффективностью систолических массивов. Intel, AMD и китайские производители претендуют на 10–15% рынка к 2028 году.

Реальность 2025 года: ни одна архитектура не доминирует абсолютно. Исследовательские лаборатории полагаются на GPU для экспериментов. Облачные гиганты разворачивают TPU для production-систем с миллионами запросов в секунду. Финансовые компании строят on-premise GPU-кластеры, чтобы держать алгоритмы торговли под контролем. Автопроизводители встраивают NPU (нейронные процессоры) для inference на устройствах.

Что дальше

Следующие 12–18 месяцев покажут, кто победит в гонке за эффективность. NVIDIA удерживает экосистемное преимущество: 99% курсов по машинному обучению обучают CUDA, миллионы строк корпоративного кода написаны под их архитектуру. Google делает ставку на интеграцию: TPU встроены в сервисы Vertex AI, где разработчик получает готовую инфраструктуру нажатием кнопки.

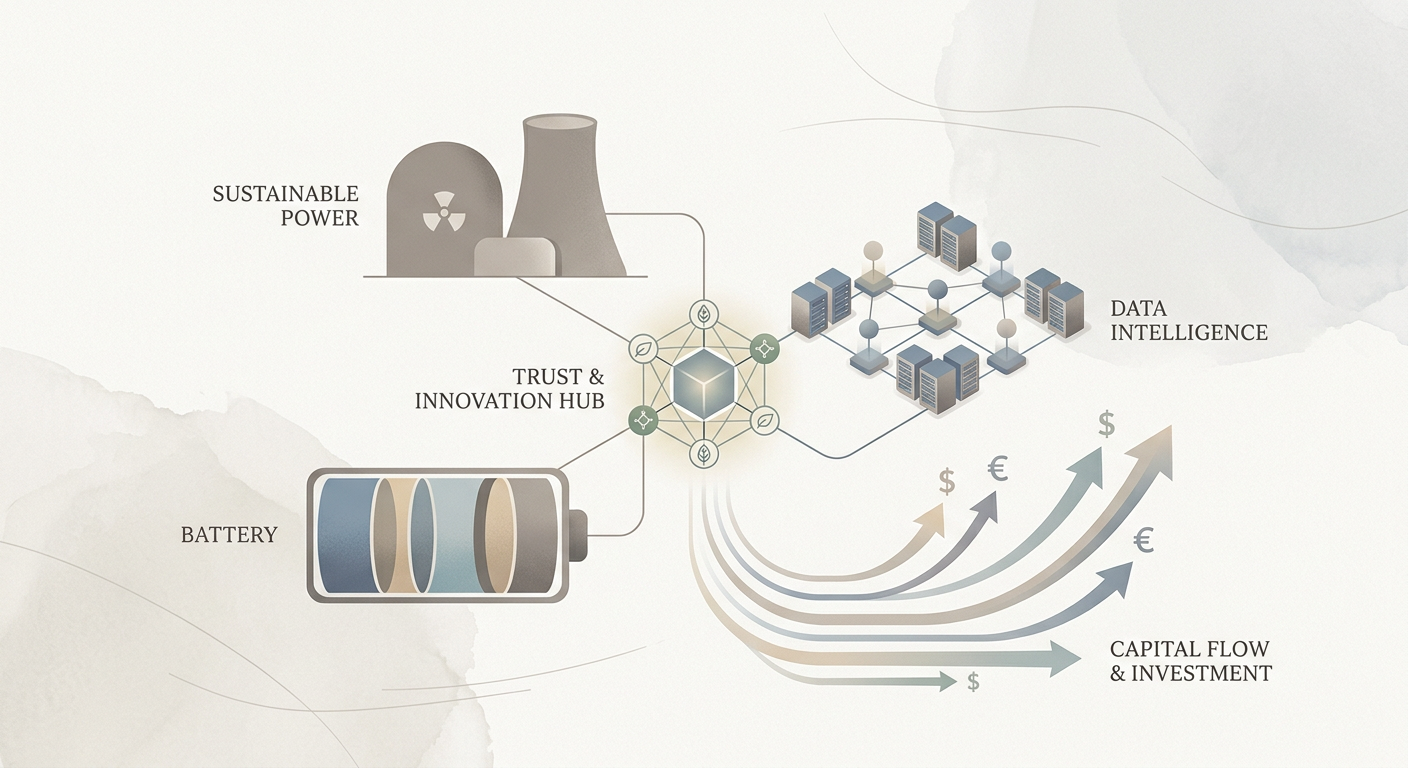

Ключевой вопрос — энергия. Обучение GPT-4 потребовало энергии, эквивалентной годовому потреблению небольшого города. При текущих темпах роста масштабов моделей индустрии придётся выбирать между универсальностью GPU и эффективностью TPU. Появление гибридных архитектур может стереть границы: AMD и Intel обещают совместить лучшее из обоих миров к 2026 году.

Для бизнеса выбор упрощается до трёх вопросов: используете ли вы TensorFlow, нужна ли вам гибкость разработки, критична ли энергоэффективность. Ответы определят, какие чипы окажутся в ваших серверных стойках — и сколько денег останется в бюджете на следующий квартал.

Узнать больше

NVIDIA H100 Tensor Core GPU

Флагманский графический процессор для обучения и вывода больших языковых моделей. 80 ГБ HBM3, 3,35 ТБ/с пропускная способность, поддержка CUDA, PyTorch, TensorFlow.

Google Cloud TPU v5e

Тензорный процессор для масштабного обучения нейросетей в облаке. До 8960 чипов в pod, оптимизация под TensorFlow и JAX, энергоэффективность в 2–3 раза выше GPU.

Практические рекомендации

Используйте GPU, если: вы прототипируете модели, работаете с PyTorch, нужна гибкость фреймворков или требуются научные расчёты с двойной точностью. Начните с облачной аренды (AWS, Azure), прежде чем инвестировать в собственное железо.

Выбирайте TPU, если: обучаете большие языковые модели на TensorFlow, критична энергоэффективность, работаете в Google Cloud. Оцените затраты на переписывание пайплайнов данных — экономия 20–30% окупит время инженеров.

Рассмотрите гибридный подход: разработка и эксперименты на GPU, production-обучение масштабных моделей на TPU. Изолируйте критичные части кода, чтобы минимизировать зависимость от платформы.

Источники

Материал подготовлен на основе технических сравнений Wevolver и MarkTechPost (август–сентябрь 2025), аналитических отчётов Mordor Intelligence и ByteBridge о рынке AI-ускорителей, официальной документации NVIDIA H100 и Google Cloud TPU, а также интервью с инженерами машинного обучения. Данные о производительности взяты из публичных бенчмарков MLPerf и документации производителей. Прогнозы рынка основаны на отчёте Mordor Intelligence «AI Accelerators Market 2025–2030». Информация актуальна на 5 ноября 2025 года.