Microsoft категорически отказывается от romantic AI и эротического контента даже для взрослых, позиционируя Copilot как «AI для родителей, которому можно доверить детей»

Новая функция Groups позволяет до 32 человек совместно работать с AI-ассистентом, смещая фокус с human-AI на human-to-human взаимодействие через AI

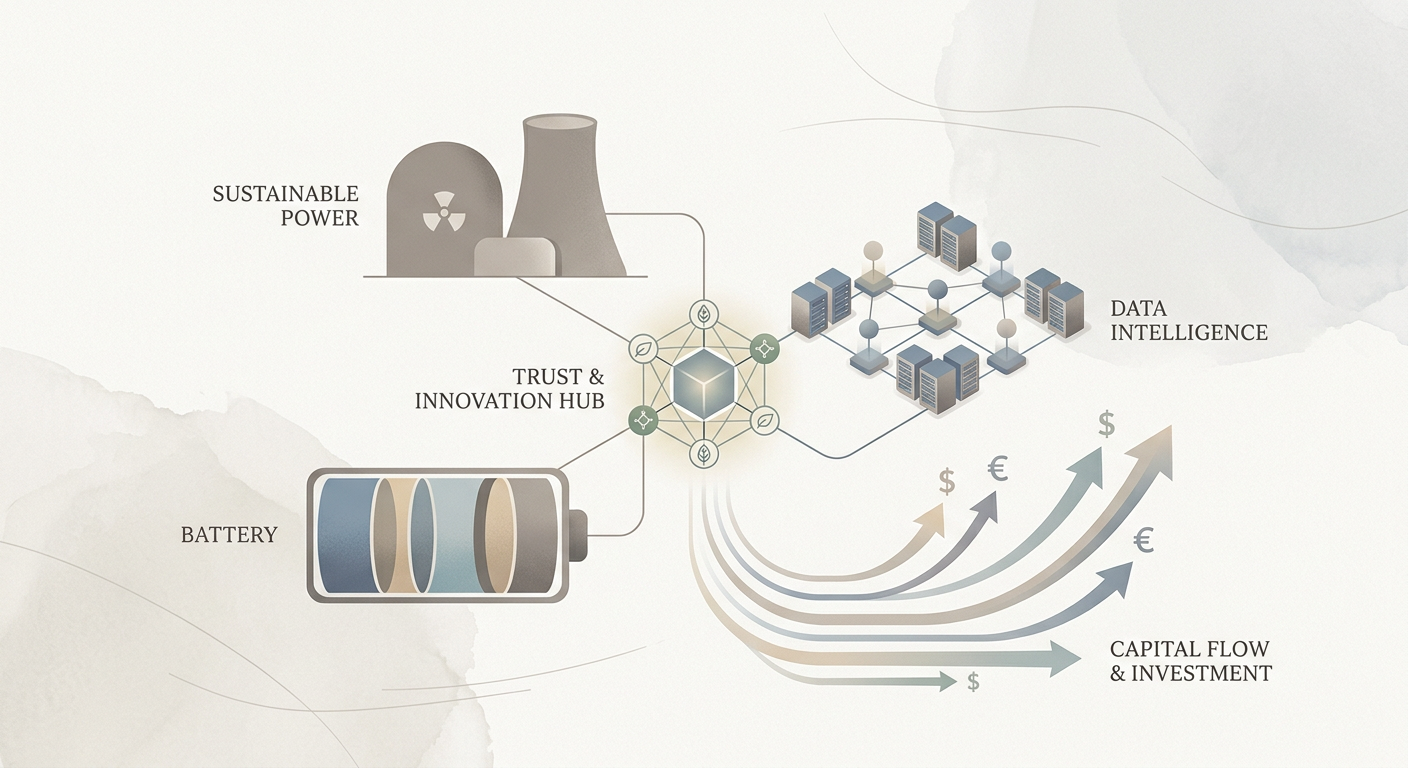

При 100 миллионах активных пользователей против 800 миллионов у ChatGPT, Microsoft делает ставку на доверие и безопасность как конкурентное преимущество в корпоративном сегменте

Стратегия доверия в эпоху AI-романтики

Microsoft объявила о масштабном обновлении Copilot 23 октября 2025 года, заняв радикально иную позицию на рынке AI-ассистентов. В то время как OpenAI, Meta и Character.AI движутся в сторону эмоциональных, романтических и даже сексуализированных взаимодействий с пользователями, Microsoft провела чёткую границу: никакого флирта, романтики или эротики — даже для взрослых.

«Мы создаём AI с эмоциональным интеллектом, сострадательный и поддерживающий, но принципиально безопасный», — заявил CEO Microsoft AI Мустафа Сулейман в интервью CNN. «Моя цель — создать AI, которому родители могут доверить своих детей. Это требует установления границ и обеспечения безопасности».

Заявление прозвучало на фоне судебных исков против Character.AI и OpenAI от семей, чьи дети, по их утверждениям, пострадали от взаимодействия с chatbot'ами, включая случаи, связанные с суицидами подростков. Meta также попала под критику после сообщений о том, что её AI-персонажи вступают в сексуальные диалоги даже с пользователями, указавшими несовершеннолетний возраст.

Copilot: 100 миллионов активных пользователей

ChatGPT (OpenAI): 800 миллионов ежемесячных активных пользователей

Разрыв в 8 раз даёт Microsoft стимул к дифференциации через безопасность

Технология human-centered AI

Осеннее обновление Copilot включает пять ключевых нововведений, которые реализуют концепцию «AI для людей, а не вместо людей»:

1. Groups (совместные чаты). До 32 человек могут одновременно взаимодействовать с Copilot в общем пространстве. Примеры использования: студенты, работающие над групповым проектом, друзья, планирующие путешествие, команды, обсуждающие стратегию. AI выступает как модератор и помощник, а не как замена человеческого общения.

2. Memory (контекст прошлых разговоров). Copilot теперь может обращаться к истории диалогов для более персонализированных ответов, учитывая предпочтения и предыдущий контекст пользователя.

3. Health queries (медицинские запросы). Интеграция с проверенными медицинскими источниками, включая Harvard Health. При запросе о симптомах или лечении Copilot предлагает список местных врачей и ссылается только на научно обоснованные данные. Это прямая конкуренция с поисковыми системами в нише health search.

4. "Real talk" mode (неформальный режим). Опциональный игривый тон общения, который, тем не менее, остаётся в рамках установленных этических границ — без романтизации или флирта.

5. Browser context integration. Включена интеграция с Google и другими браузерными сервисами, расширяя функциональность ассистента за пределы экосистемы Microsoft.

Мы создаём AI для людей, а не для имитации человеческих личностей. Это принципиальная разница.— Мустафа Сулейман, CEO Microsoft AI

Бизнес-приложения и конкурентная стратегия

Целевая аудитория: Корпоративный сегмент, образовательные учреждения, семьи с детьми. Microsoft делает ставку на консервативных клиентов, для которых безопасность и контроль важнее эмоциональной вовлечённости AI.

Use case 1: Образование. Функция Groups позволяет учителям организовывать групповую работу студентов с AI-поддержкой, где Copilot выступает как тьютор, но не заменяет peer-to-peer обучение. Это решает проблему изоляции, связанную с индивидуальным использованием AI.

Use case 2: Enterprise collaboration. Команды могут использовать Groups для мозговых штурмов, где AI генерирует идеи на основе коллективного ввода, а не индивидуальных запросов. Это создаёт новую категорию collaborative AI.

Use case 3: Family safety. Родители могут использовать Copilot для образовательных целей детей, не опасаясь неподходящего контента. Это единственный крупный AI-ассистент, который явно позиционируется как «child-safe by design», а не через опциональные детские режимы.

Отказ от эмоционального AI может ограничить user engagement и retention в consumer-сегменте

Конкуренты (OpenAI, Meta) разрешили «эротику» для взрослых, что может привлечь часть аудитории

Microsoft рискует потерять долю на рынке персональных AI-компаньонов в пользу более «человечных» альтернатив

Конкурентное преимущество: Microsoft позиционирует себя как единственная крупная tech-компания, готовая пожертвовать краткосрочной вовлечённостью ради долгосрочного доверия. Это критически важно для enterprise-клиентов, которые не могут позволить себе репутационные риски, связанные с controversial AI.

Прогноз развития human-centered AI

Ближайшие 12 месяцев (до Q4 2026):

Ожидается усиление регулятивного давления на romantic AI после недавних судебных исков. California уже приняла SB 243 (safeguards для companion chatbots) в октябре 2025. Стратегия Microsoft может стать «first-mover advantage» перед волной новых законов о child safety в AI.

OpenAI и Meta, вероятно, будут вынуждены ввести более строгие возрастные ограничения и parental controls. Однако полный отказ от эмоционального AI маловероятен — это слишком большой рынок (Character.AI достигла оценки $1 млрд именно на romantic chatbots).

2027-2028:

Возможна фрагментация рынка AI-ассистентов на два сегмента:

1. Professional AI (Microsoft, Google в корпоративном режиме) — без романтики, с акцентом на productivity

2. Companion AI (Character.AI, Replika, потенциально OpenAI/Meta) — с эмоциональной привязкой, для personal use

Microsoft может стать de facto стандартом для государственных учреждений, школ и консервативных корпораций. Однако consumer-сегмент, особенно Gen Z, может предпочесть более «человечные» альтернативы.

Динамика роста пользовательской базы Copilot в Q1-Q2 2026 покажет, работает ли стратегия доверия

Судебные precedenты по искам против Character.AI и OpenAI установят границы ответственности AI-компаний за контент

Adoption rate Groups-функции в enterprise-сегменте определит, является ли collaborative AI viable категорией

Microsoft Copilot

Попробуйте новые функции Copilot: Groups для совместной работы, memory для персонализации, улучшенные медицинские запросы. Единственный крупный AI-ассистент с гарантией child safety и отказом от romantic content.

Источники

Материал подготовлен на основе интервью CEO Microsoft AI Мустафы Сулеймана для CNN, официального пресс-релиза Microsoft от 23 октября 2025, публикаций Reuters и отчёта о последних earnings Microsoft. Данные об активных пользователях Copilot и ChatGPT взяты из официальных заявлений компаний. Информация о судебных исках и регулировании проверена через базу данных NCSL (National Conference of State Legislatures) и California Legislative Information. Данные актуальны на 26 октября 2025.