OpenAI подписала 7-летний контракт с AWS на $38 млрд, получив доступ к сотням тысяч GPU NVIDIA и десяткам миллионов CPU по всему миру

Все мощности будут развёрнуты к концу 2026 года с возможностью расширения до 2027 и далее

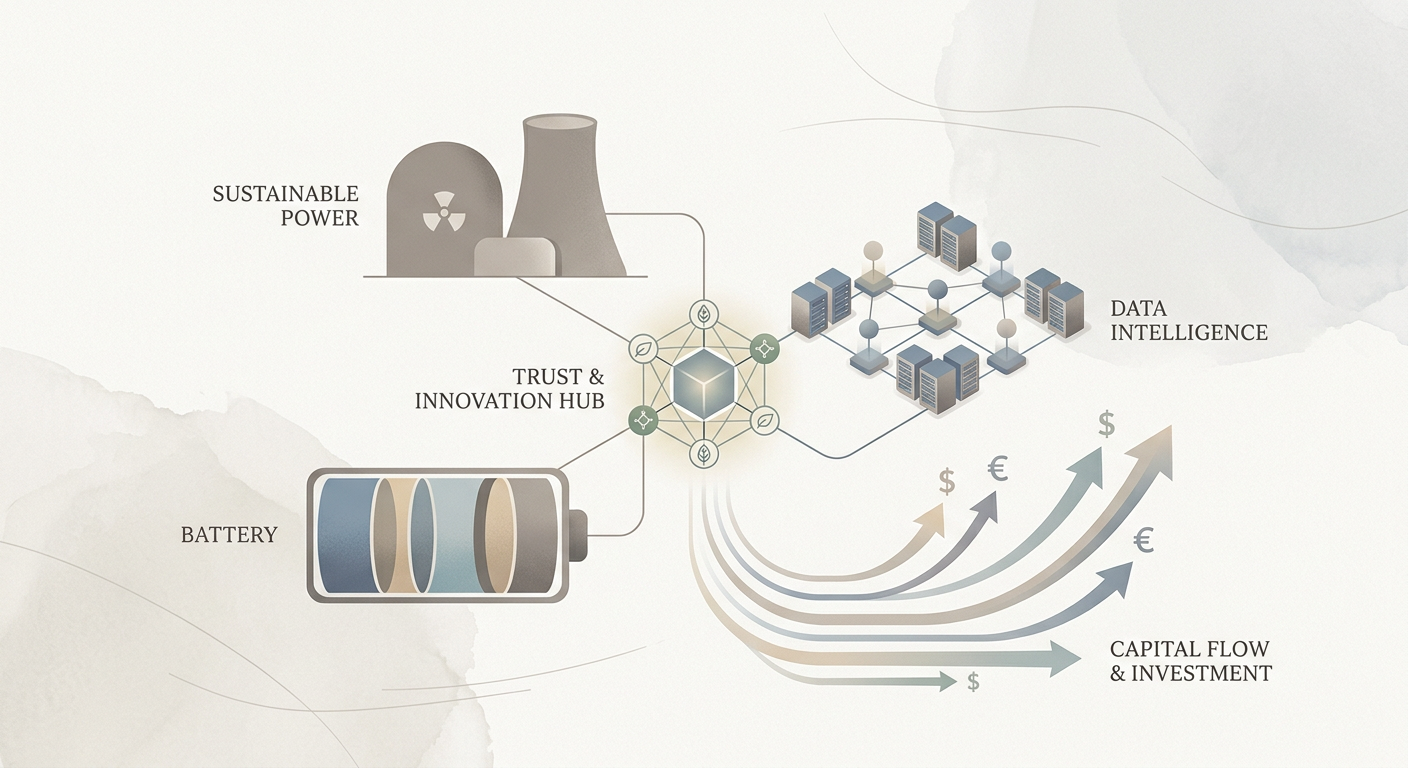

Это стратегический разворот от эксклюзивной зависимости от Microsoft Azure к многооблачной архитектуре, снижающей риски и повышающей гибкость

Почему это имеет значение за пределами технологических кругов

Сделка между OpenAI и AWS — это не просто коммерческое соглашение. Это переломный момент в экосистеме искусственного интеллекта, который затронет стоимость вычислений, цены на облачные сервисы и конкурентные позиции технологических гигантов. Когда лидер отрасли (OpenAI с её ChatGPT) перестаёт полагаться на единственного поставщика инфраструктуры, это сигнализирует о том, что модель облачных вычислений больше не может быть монопольной.

Это также подталкивает другие компании переоценить свою облачную стратегию. Если OpenAI может себе позволить диверсификацию, значит, и другие AI-компании начнут требовать большей независимости от поставщиков.

OpenAI предприятие, стремящееся потратить более $1 трлн на развитие вычислительной мощности в течение следующего десятилетия. Каждый контракт на $38 млрд — это часть этого титанического плана

AWS получает стабильный источник доходов, Microsoft теряет исключительное право на инфраструктуру своего партнёра, а NVIDIA остаётся ключевым поставщиком GPU независимо от облачного провайдера

Архитектура инфраструктуры: что это означает технически

Сделка предусматривает развертывание на EC2 UltraServers — специализированных серверах AWS, предназначенных для работы с самыми требовательными AI-нагрузками. Вот ключевые компоненты:

GPU: NVIDIA GB200 и GB300 — ускорители последнего поколения, оптимизированные для обучения больших языковых моделей и высокопроизводительного вывода

Масштабируемость: сотни тысяч GPU и десятки миллионов CPU — позволяет OpenAI запускать как специализированные задачи обучения, так и параллельные задачи вывода для миллионов пользователей

Низкие задержки через высокопроизводительные межсоединения — критично для координации работы тысяч ускорителей одновременно

Поддержка пользовательских чипов AWS (Trainium2, Inferentia2) — дополнительный уровень гибкости и потенциального снижения затрат

Стратегические последствия для отрасли

Это решение OpenAI иллюстрирует разоружение облачной монополии. Ещё в 2019 году OpenAI была практически связана Microsoft Azure многомиллиардными инвестициями и эксклюзивными соглашениями. Но к 2025 году компания активно диверсифицирует свои ставки:

- Контракты с Oracle на облачную инфраструктуру

- Партнёрство с SoftBank и ОАЭ на строительство дата-центров

- Прямые контракты с производителями чипов: NVIDIA, AMD, Broadcom

- Теперь — $38 млрд на AWS

Эта многооблачная архитектура решает несколько проблем одновременно:

Переговорная позиция: множество поставщиков означает лучшие цены и условия

Надёжность: если один провайдер отказывает, другие продолжают работу

Инновационная гибкость: различные регионы и провайдеры предлагают разные технологии — AWS даёт пользовательские чипы Trainium, другие провайдеры предлагают иные решения

Подготовка к IPO: разнообразный портфель партнёров выглядит привлекательнее для инвесторов, чем зависимость от одного

Временная шкала внедрения

Развертывание происходит в две фазы:

| Период | Мероприятие |

|---|---|

| Ноябрь 2025 — конец 2026 | Развертывание всей запланированной мощности на AWS — сотни тысяч GPU и десятки миллионов CPU |

| 2027 и далее | Расширение за пределами первоначального соглашения при необходимости |

Это компактный временной горизонт. OpenAI спешит, потому что мир AI движется быстро, и каждый месяц задержки означает потерю конкурентного преимущества.

Что отслеживать в ближайшие 12–24 месяца

Q1 2026: Первые публичные отчёты о производительности OpenAI на AWS инфраструктуре

Q4 2026: Полное развертывание всех мощностей. Ожидаем пресс-релизов о достижениях и новых моделях

2027: Появятся ли новые agentic модели или приложения, специфичные для AWS? Какие успехи в снижении себестоимости обучения?

Ответная реакция Microsoft: как Microsoft защитит свою позицию в облачном AI?

Риски и ограничения

Сделка впечатляет по масштабам, но не лишена вызовов:

- Интеграционная сложность: миграция критически важных AI-рабочих нагрузок с Azure на AWS требует огромных усилий по переконфигурации и тестированию

- Вопросы о возврате инвестиций: некоторые аналитики видят в этой трате признаки AI-пузыря с неясными шансами на окупаемость

- Техническая задолженность: поддержание множества облачных платформ одновременно требует инженерных ресурсов и стратегического фокуса

Об этом материале

Этот анализ подготовлен на основе официальных заявлений AWS и OpenAI, технических докладов, аналитических обзоров. Использованы актуальные данные о стоимости, масштабах и сроках реализации на состояние ноября 2025 года.

Практические идеи для вашей организации

Для CTO и IT-лидеров: если ваша компания рассматривает облачные AI-сервисы, это хороший знак диверсификации. Не ставьте всё на одного провайдера — модель OpenAI показывает, что гибкость платит. Для стратегических партнёров: если вы работаете с OpenAI, ожидайте, что её сервисы и модели станут доступны через AWS-интеграции. Это расширит ваши возможности интеграции.

Источники информации

Материал подготовлен на основе официальных пресс-релизов AWS и OpenAI (ноябрь 2025), технических статей TechCrunch, CNBC, Data Center Knowledge и ApplyingAI. Все цифры и сроки актуальны на 8 ноября 2025 года.