Акции QCOM взлетели на 19%, достигнув 52-недельного максимума $240+ после анонса технических характеристик: 768GB LPDDR память, 160kW стойки с жидкостным охлаждением

Первый крупный клиент — саудовская Humain с развертыванием на 200MW, переговоры ведутся с Microsoft, Amazon и Meta для диверсификации от зависимости на 70% от смартфонов

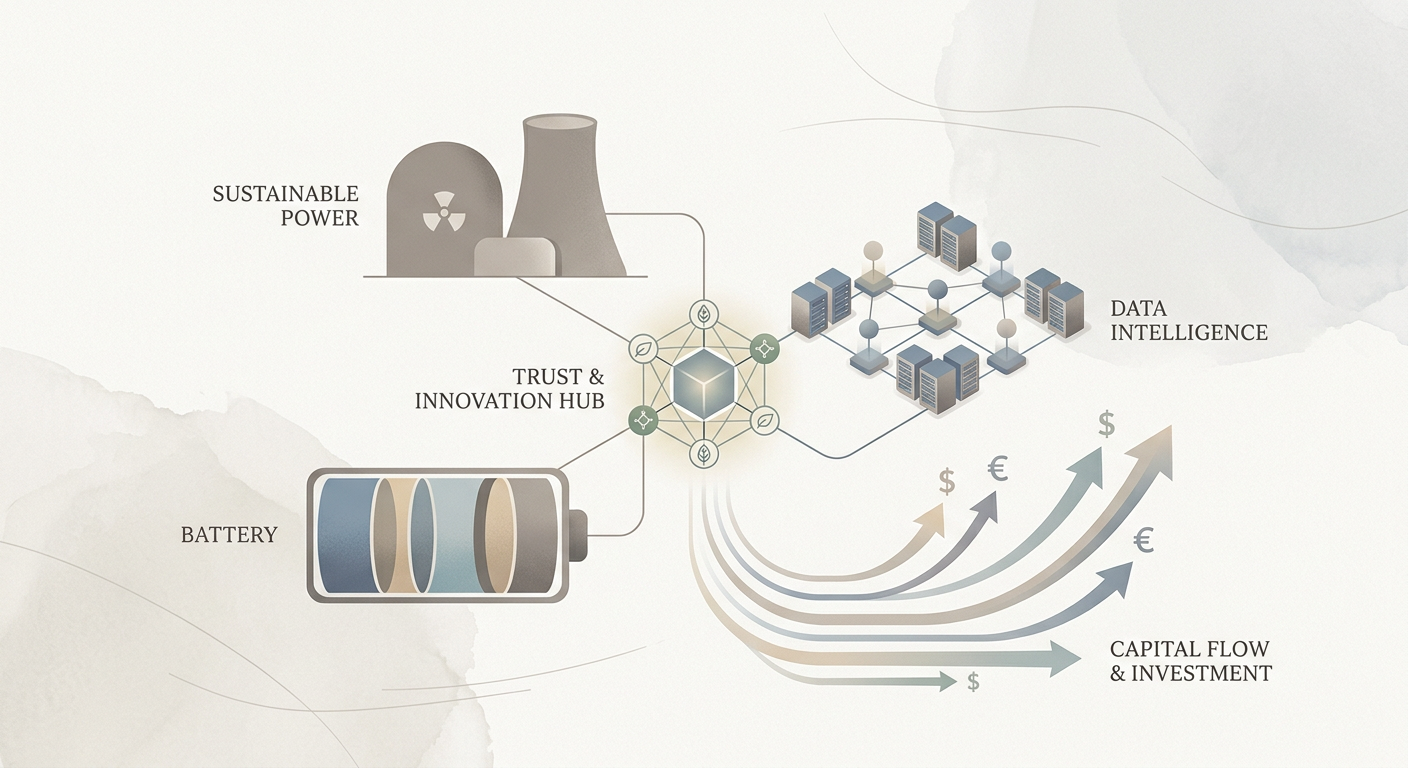

Битва за $6.7 трлн рынок AI-инфраструктуры

Анонс AI200 и AI250 представляет собой не просто новые продукты, а стратегическую попытку переписать правила игры в секторе AI-ускорителей. NVIDIA контролирует 80-90% рынка благодаря своим H100/H200 GPU, но высокая стоимость ($25,000-40,000 за чип) и дефицит поставок создали окно возможностей для конкурентов.

Реакция рынка была мгновенной: акции Qualcomm подскочили на 19% до $240+, добавив $30+ млрд к капитализации за один день. Инвесторы увидели в этом шаге потенциал диверсификации от мобильного бизнеса, который генерирует 70% выручки компании.

Техническая архитектура и конкурентные преимущества

AI250 (2027): 10-кратное улучшение пропускной способности, near-memory computing, стойки 160kW с жидкостным охлаждением. Позиционируется как альтернатива H200/B200 от NVIDIA.

Ключевое отличие подхода Qualcomm — использование LPDDR памяти вместо дорогостоящей HBM (High Bandwidth Memory), которую применяет NVIDIA. Это решение может существенно снизить стоимость производства, но возникают вопросы о пропускной способности для тяжелых AI-ворклоадов.

Архитектурное решение базируется на проверенной технологии Hexagon NPU, которая показала эффективность в мобильных устройствах. Адаптация для серверного сегмента включает масштабирование вычислительных блоков и интеграцию специализированных ускорителей для трансформеров.

Стратегия liquid-cooled стоек позволяет достичь плотности 160kW на стойку — показатель, сопоставимый с решениями NVIDIA, но с потенциально меньшими затратами на инфраструктуру охлаждения.

Бизнес-модель Qualcomm строится на трех ключевых преимуществах:

Ценовое позиционирование: AI200/AI250 будут стоить существенно дешевле аналогов NVIDIA, что критично для компаний, масштабирующих AI-инфраструктуру в условиях высоких капзатрат.

Энергоэффективность: Опыт в мобильной оптимизации позволяет достичь лучших показателей Performance-per-Watt, что снижает операционные расходы дата-центров.

Диверсификация поставок: Клиенты заинтересованы в альтернативах NVIDIA для снижения vendor lock-in рисков, особенно в условиях геополитической напряженности вокруг тайваньского TSMC.

Модель go-to-market включает прямые продажи крупным облачным провайдерам и партнерства с OEM-производителями серверов, такими как HPE и Dell.

Риски и перспективы рыночной экспансии

Перспективы роста:

- Рынок AI-чипов для дата-центров растет на 35% год к году

- Increasing demand для AI-инференса (в отличие от тренинга) играет в пользу Qualcomm

- Геополитические риски TSMC стимулируют поиск альтернатив

Ключевые риски:

- Экосистема ПО: CUDA доминирует, переход на альтернативы требует значительных инвестиций

- Производственные мощности: зависимость от TSMC сохраняется и для Qualcomm

- Timing: запуск в 2026-2027 может оказаться поздним, если NVIDIA представит следующее поколение

Успех стратегии будет зависеть от способности привлечь крупных клиентов для первоначального развертывания и создания референсных кейсов, доказывающих эффективность альтернативы NVIDIA-centric инфраструктуре.

Исследование: "AI Infrastructure Market Analysis 2025" от Omdia — детальный анализ конкурентной динамики и прогнозы капвложений в AI-инфраструктуру до 2030 года

Источники

Reuters: "Qualcomm announces new AI chips in data center push" (27.10.2025)

CNBC: "Qualcomm AI200-AI250 AI chips NVIDIA AMD competition" (27.10.2025)

Yahoo Finance: "Qualcomm stock spikes 20% as company enters AI chip race" (27.10.2025)

Bloomberg: "Qualcomm Unveils Chip to Rival Nvidia in AI Accelerator Market" (27.10.2025)

Wall Street Journal: "Qualcomm Launches AI Chips to Challenge Nvidia's Dominance" (27.10.2025)

SSB Crack News: "Qualcomm Enters AI Data Center Race with New Chips" (26.10.2025)