Ключевые выводы

Google, Meta и Microsoft вложили свыше $230 млрд в 2025 году только в построение ИИ-инфраструктуры, включая разработку собственных чипов и мега-центров обработки данных. Это финансирование уже генерирует экономический эффект в размере $923 млрд и поддерживает 2,7 млн рабочих мест, но также создаёт риск «ИИ-пузыря» — текущие доходы ($20 млрд ежегодно) должны вырасти в 100 раз к 2030 году, чтобы оправдать инвестиции.

Вертикальная интеграция (собственные чипы + облачная инфраструктура + операционная экспертиза) стала главным конкурентным преимуществом: Google полагается на TPU Ironwood, Meta развёртывает 1,3 млн GPU, Microsoft инвестирует $80 млрд в Azure и пользовательские ускорители, а энергопотребление центров обработки данных утроится к 2028 году и может потребить больше электричества, чем целые страны.

Глобальная переоценка компьютерных мощностей

Последние три года инвестиции в ИИ-инфраструктуру выросли с периферийного тренда в центральную стратегию технологических гигантов. Причина проста: производство продвинутых языковых моделей требует вычислительной мощности несравнимой ни с чем, что техиндустрия видела раньше. Один запрос к ChatGPT потребляет в 10 раз больше электроэнергии, чем обычный поиск в Google.

Масштаб финансирования беспрецедентен. По данным TokenRing AI, Google, Meta, Microsoft и Amazon планируют потратить почти $370 млрд только на строительство центров обработки данных и ИИ-инфраструктуры в 2025 году. Для контекста: это больше, чем годовой бюджет многих стран.

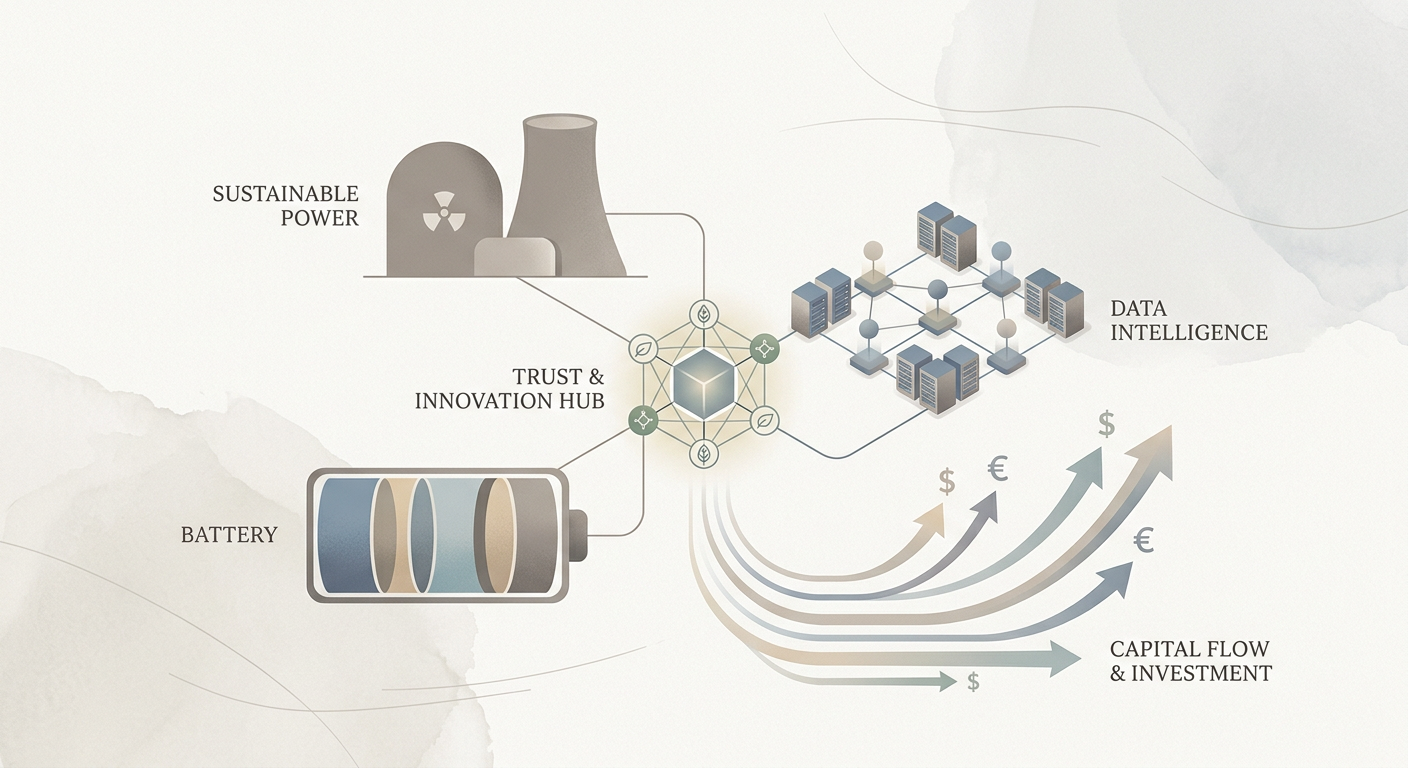

Инфраструктурные инвестиции в ИИ — это не просто покупка серверов. Это стимул экономического развития, сравнимый по масштабу с электрификацией или развитием интернета. Энергетическому сектору нужны новые мощности, строительству нужны контракты, производству полупроводников нужны заказы. Заработная плата программистов, инженеров, строителей растёт. Это становится ведущей переходной точкой в создании долгосрочной стоимости.

Архитектурные стратегии технологических лидеров

Каждый из трёх гигантов выбрал собственный путь вертикальной интеграции, но все согласны в одном: контролировать весь стек «от кремния до ПО» означает контролировать будущее ИИ.

Google: Специализированные чипы вместо универсальных решений

TPU Ironwood (Trillium generation), представленный в апреле 2025 года, — это кастомный чип, созданный исключительно для ИИ-инференса. Его пиковая производительность составляет 4614 TFLOP/s (кратко: триллион операций с плавающей запятой в секунду). Google развёртывает TPU кластерами, включая конфигурации из 9216 чипов одновременно.

Главное преимущество TPU перед универсальными GPU (которые используют конкуренты) — энергоэффективность. Кастомная архитектура означает:

- Выше производительность на ватт электроэнергии

- Ниже стоимость владения при больших масштабах развёртывания

- Лучшая оптимизация для специфических нейросетевых операций (умножение матриц, свёртка)

Компания Anthropic, разработчик Claude, уже подписала контракт на доступ к одному миллиону TPU от Google Cloud к 2026 году. Это является прямым свидетельством того, что индустрия признаёт качество инфраструктуры Google.

Meta: Открытая модель и масштабирование мощности

Meta выбрала другой путь: вместо собственных чипов — максимальное масштабирование GPU. К концу 2025 года Meta развернёт 1,3 млн графических процессоров. Капитальные расходы Meta составляют $70–72 млрд в 2025 году, и траектория инвестиций направлена в сторону ещё большего роста.

Стратегия Meta сосредоточена на:

- Llama 4 — новое поколение открытой языковой модели с поддержкой 200 языков и увеличенным контекстным окном

- Mixture-of-Experts (MoE) архитектура — система маршрутизации подзадач к специализированным подсетям вместо загрузки полной модели. Это значительно снижает задержку инференса

- Speculative decoding — техника ускорения генерации текста на GPU

- Партнёрства с Cerebras и Groq для достижения скоростей до 18x раз выше традиционных GPU-решений

Meta считает, что открытый подход (Llama доступна бесплатно) позволит ей захватить разработчиков, закрепиться в экосистеме, и в конечном итоге монетизировать через облачные сервисы и рекламу (которая становится более точной благодаря ИИ-аналитике).

Microsoft: Гибридная стратегия и масштабирование через партнёрство

Microsoft выделил $80 млрд на ИИ-инфраструктуру в финансовом 2025 году. Это самый крупный инвестиционный цикл в истории компании.

Azure использует гибридный стек:

- NVIDIA Blackwell GB300 (стойки NVL72 с 72 GPU) — для максимальной производительности в облаке

- Azure Maia — собственный ускоритель для специфических ИИ-рабочих нагрузок

- Cobalt CPU — процессоры общего назначения на основе ARM

- o1 и GPT-4 Turbo в облаке — интеграция передовых моделей OpenAI (в которую Microsoft инвестировала $10 млрд)

Такая гибридность позволяет Microsoft предложить клиентам оптимальное соотношение цены и производительности для разных сценариев использования — от высокопроизводительных вычислений до экономичных батч-операций.

Google: Кастомные чипы TPU + облако. Минимизирует затраты при масштабировании, но требует в-доме экспертизы по чипдизайну. Фокус на эффективности энергопотребления.

Meta: Максимальное количество GPU + открытые модели. Дорого в краткосрочном периоде, но создаёт разработчическую базу и сетевой эффект. Покупает скорость через силу брутто-применения.

Microsoft: Кастомные чипы + NVIDIA + OpenAI. Балансирует между инновацией и коммерческой практичностью. Позволяет предложить максимум вариаций решений на Azure.

Практическое применение и риски

Кто выигрывает?

Стартапы, ориентированные на прикладной ИИ становятся главными бенефициарами. Они получают доступ к облачной инфраструктуре, готовым моделям и вычислительным ресурсам по цене, которая всё ещё ниже, чем строить собственный центр обработки данных. Это ускоряет итерацию продуктов и выход на рынок.

Производители полупроводников (NVIDIA, AMD, Intel, Qualcomm) видят беспрецедентный спрос на специализированные чипы. NVIDIA, в частности, удерживает 94% рынка GPU для центров обработки данных.

Поставщики облачных услуг (Microsoft Azure, Google Cloud, AWS) видят взрывной рост доходов от ИИ-сервисов. Azure теперь является одним из ведущих источников дохода Microsoft.

Какие риски?

Текущие доходы от ИИ-продуктов составляют примерно $20 млрд ежегодно. Для оправдания инвестиций в размере $1+ трлн инвестиции должны дойти до $2 трлн доходов к 2030 году. Это требует увеличения в 100 раз. Хотя потенциал велик, риск переинвестирования существует. Meta CEO Марк Цукерберг и OpenAI CEO Сэм Альтман открыто высказали опасения по поводу переинвестирования.

Симптомы: закрытие стартапов ИИ, отказы от пилотных проектов в корпоративном секторе, падение стоимости GPU при переизбытке мощностей.

Энергопотребление и поддержка инфраструктуры. Центры обработки данных США потребляли 4,4% национальной электроэнергии в 2023 году. К 2028 году эта цифра может утроиться. ИИ-системы к концу 2025 года могут потребляют до 49% всей мощности центров обработки данных. Это создаёт давление на энергосиди и может способствовать инфляции счётов за электричество.

Концентрация власти и технологической зависимости. Amazon, Microsoft и Google контролируют 63% рынка облачной инфраструктуры. NVIDIA владеет 94% рынка GPU. Такая концентрация означает потенциальные риски:

- Единые точки отказа в критических системах

- Ограничение конкуренции в инновациях

- Возможность цензуры контента через контроль инфраструктуры

- Уязвимость цепи поставок (например, санкции на NVIDIA или ARM)

Недоиспользованная мощность (GPU stranding). Многие компании закупили больше GPU, чем реально используют. Проблема усугубляется сетевыми узкими местами, которые снижают пропускную способность инфраструктуры. Результат: потраченные миллиарды на оборудование, которое простаивает.

Use cases, которые уже работают

- Улучшение рекламной таргетизации — Google и Meta используют ИИ для точной привязки объявлений к аудитории, повышая ROAS (возврат инвестиций в рекламу)

- Интеграция в Office и Workplace — Microsoft добавляет ИИ-ассистентов в Word, Excel, Teams; Google то же делает в Workspace

- Аналитика и предиктивное обслуживание — предсказание сбоев, оптимизация цепочек поставок

- Автоматизация customer service — чат-боты, которые могут решить 70–80% рутинных запросов

Что отслеживать в ближайшие годы

Оптимистичный (вероятность: 30%): ИИ генерирует неожиданно высокие доходы благодаря новым применениям (автономные системы, научные открытия), пузырь не лопается, инвестиции продолжают расти. Доминирующие компании зарабатывают триллионы.

Реалистичный (вероятность: 50%): Рост замедляется после 2026–2027, часть инвестиций признаётся убыточной (медленное сдувание пузыря). Концентрация рынка ещё больше: только 3–4 компании контролируют доступ к ИИ-инфраструктуре. Меньшие компании ищут нишевые применения.

Пессимистичный (вероятность: 20%): Технические потолки (закон Мура замедляется), энергетический кризис, регуляторные ограничения приводят к корректировке инвестиций на 50%. Начинается реструктуризация компаний и волна банкротств стартапов.

Отслеживайте в ближайшие 1–3 года:

- Квартальные отчёты крупных техкомпаний. Инвесторы ищут конкретные доказательства того, что ИИ-инвестиции генерируют реальный доход, а не просто расходуют капитал

- Прорывы в энергоэффективности ИИ. Если появятся модели, потребляющие в 10x раз меньше мощности при той же производительности, пузырь мог быть преждевременным

- Новые игроки в чипмейкинге. Успешный выход на рынок альтернативных производителей GPU (AMD, Intel, новых стартапов) мог бы снизить NVIDIA-зависимость

- Появление сетевых инноваций. Если компании научатся более эффективно использовать существующую инфраструктуру, давление на новые инвестиции снизится

- Развитие edge AI и локального инференса. Если ИИ смещается на устройства пользователя (ноутбуки, телефоны), облачная инфраструктура может потребоваться менее интенсивно

Главный вывод для бизнеса

Триллионные инвестиции в ИИ-инфраструктуру — это не просто финансовый цикл. Это фундаментальная переоценка того, как строится, контролируется и монетизируется компьютерная мощь в 21 веке. Компании, которые владеют или имеют привилегированный доступ к инфраструктуре (Google, Meta, Microsoft, Amazon, NVIDIA), будут доминировать в течение следующего десятилетия.

Для остальных компаний стратегия проста: либо строить нишевые ИИ-приложения на облачной инфраструктуре гигантов, либо специализироваться на vertical-specific моделях и решениях, которые крупные компании не будут эффективно поддерживать.

Дополнительные ресурсы

Stargate Initiative (OpenAI + SoftBank + Oracle)

$500 млрд проект по строительству самой крупной ИИ-инфраструктуры в мире. Запуск в 2026 году. Полезно отслеживать как противовес Google–Meta–Microsoft альянсам.

Azure AI Infrastructure Docs

Официальная документация Microsoft Azure по ИИ-инфраструктуре, включая информацию о TPU, Maia, Blackwell GPU и стоимости.

Artificial Analysis — Benchmark Сравнения LLM

Независимое сравнение производительности языковых моделей (включая параметры, задержку, стоимость). Полезно для отслеживания того, как инвестиции преобразуются в производительность.

Практические идеи для руководителей

Для бизнеса это означает следующее: начните разрабатывать ИИ-стратегию прямо сейчас, даже если вы не готовы полностью. Облачные провайдеры будут только расширять предложение и снижать входные барьеры. Второе: отслеживайте энергопотребление любых ИИ-инвестиций — это скоро станет основным бюджетным фактором. Третье: не попадайте в ловушку переинвестирования в собственную инфраструктуру ИИ, если вы не конкурируете с Google или Meta.

Источники информации

Источники

Материал подготовлен на основе официальных пресс-релизов Google, Meta, Microsoft, отчётов TokenRing AI, финансовых сообщений от Financial Content и аналитики Artificial Analysis. Данные актуальны на 30 октября 2025 года. Информация собрана из открытых источников и регулярных публикаций глобальных СМИ, специализирующихся на технологиях и инвестициях в ИИ.